Neurônios Minimalistas: A Magia de Pequenas Redes Neurais no Controle de Variáveis Contínuas

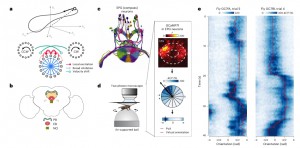

Legenda: a, Parte superior: um manifold em forma de anel da atividade neural. Parte inferior: uma rede de atratores em anel mantém uma representação interna da orientação por meio de excitação local (vermelho) e inibição ampla (azul). Dois anéis laterais usam a entrada da velocidade angular para alterar essa representação (verde). CW, no sentido horário; CCW, no sentido anti-horário.

b, Esquema do complexo central (CX) da mosca. Neurônios “bússola” inervam o corpo elipsoide (EB) e mantêm uma representação interna da orientação. Neurônios “shift” inervam a ponte protocerebral (PB) e alteram a representação por meio de entradas de velocidade angular dos nodulos(NO).

c, Reconstrução de neurônios bússola por microscopia eletrônica.

d, Configuração de imagem de dois fótons para moscas andando amarradas. Caixa: 32 regiões de interesse (ROIs) são usadas para calcular a média do vetor populacional (PVA) da mudança na fluorescência (ΔF/F).

e, Neurônios bússola mantêm um pico localizado de atividade (heatmap) que acompanha a orientação da mosca (linha vermelha).

Creditos da imagem: Noorman et al, 2024

Imagine se fosse possível realizar operações complexas de navegação, memória e controle motor com uma equipe neural reduzida. Esse é o fascinante cenário revelado por um estudo recente publicado na Nature Neuroscience, onde um pequeno grupo de neurônios em moscas demonstra a capacidade de manter e atualizar representações internas precisas de variáveis contínuas – algo que antes se pensava exigir grandes redes neurais.

O estudo, liderado por Marcella Noorman e colaboradores, revoluciona o entendimento de como redes neurais de tamanho modesto podem replicar as funções de sistemas muito maiores. Usando dados de imagem de cálcio em moscas que caminhavam no escuro, os cientistas descobriram que seu sistema de direção da cabeça, apesar de pequeno, consegue representar a orientação com impressionante precisão e continuidade. Isso desafia a crença comum de que redes pequenas são capazes apenas de representações discretas.

O coração desta descoberta está na capacidade de redes neurais mínimas, como as observadas nas moscas, gerarem representações contínuas através de conexões cuidadosamente ajustadas. Ao contrário das expectativas, essas redes pequenas não sofrem com a perda de precisão de integração esperada. Este avanço amplia as fronteiras do que redes neurais menores podem alcançar, sugerindo que até mesmo cérebros pequenos podem realizar cálculos complexos com grande eficiência.

O estudo também levanta uma questão intrigante: será que redes maiores, com esse mesmo tipo de organização, poderiam representar variáveis de múltiplas dimensões com uma eficácia que antes não imaginávamos? Além disso, os autores mostram que embora o ajuste fino das conexões neurais seja necessário para alcançar essa precisão, a vulnerabilidade a ruídos pode ser um desafio para redes pequenas.

Este trabalho abre novas portas na neurociência, sugerindo que redes neurais minimalistas podem ser mais versáteis do que se acreditava. A precisão, aliada à simplicidade, pode ser a chave para desvendar mistérios maiores sobre a cognição em cérebros tanto pequenos quanto grandes.